Descifrando el Código: IA de Código Abierto vs. IA de Código Cerrado – Explorando Ventajas y Desventajas

En el mundo de las tecnologías de IA, se está librando una batalla por el control, capturando la atención de investigadores y gigantes de la industria por igual. No solo los gigantes tecnológicos están en guerra, sino que también la tecnología subyacente de la IA de Código Abierto vs IA de Código Cerrado ha llegado al foco de atención. La petición de una pausa temporal en los experimentos de IA, encabezada por visionarios como Elon Musk y destacados investigadores de ML, refleja la gravedad de la situación.

En tiempos recientes se ha presenciado un auge en el lanzamiento de numerosos modelos grandes de IA, continuamente refinados a través de la incorporación de datos adicionales. Esta feroz competencia entre empresas para convertirse en el proveedor líder de IA ha resultado en diferenciadores muy finos entre ellas. A medida que ChatGPT de OpenAI y OpenAI Playground toman la delantera en la carrera por la dominancia de la Inteligencia Artificial al democratizar el acceso para las masas, han provocado un panorama de innovación, colaboración y ocasional controversia. En este entorno en constante evolución, la búsqueda de control se intensifica, elevando las apuestas a alturas sin precedentes.

Cuando se trata del desarrollo de IA, hay dos enfoques principales: IA de código abierto y IA de código cerrado. En esta entrada de blog, profundizaremos en las principales diferencias entre estos dos modelos y exploraremos el espectro que existe entre ellos.

Ilya Sutskever, cofundador y científico jefe de OpenAI, explica su enfoque general para decidir si un modelo de IA debe ser de código abierto o cerrado. Vea más en Standford E-Corner aquí.

Código Abierto

IA de código abierto se refiere a marcos y herramientas de IA que se desarrollan y comparten abiertamente, permitiendo a cualquiera acceder, usar, modificar y distribuir el código. Los beneficios de la IA de código abierto son numerosos. Promueve la colaboración, transparencia y personalización. Los desarrolladores pueden trabajar juntos, compartir ideas y contribuir a la mejora de las tecnologías de IA. Ejemplos populares de marcos de IA de código abierto incluyen TensorFlow y PyTorch.

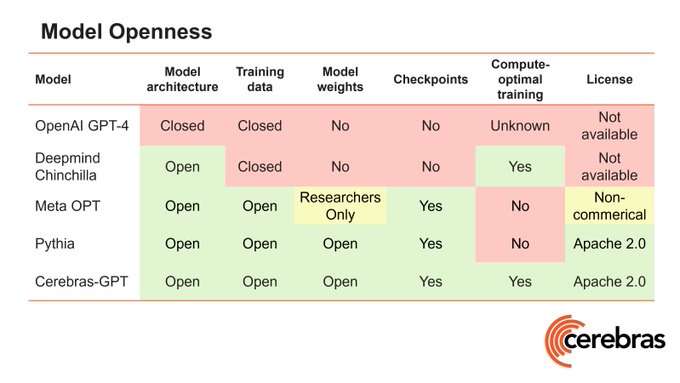

Recientemente, Cerebras hizo titulares al presentar Cerebras-GPT, afirmado como el primer modelo de lenguaje extenso totalmente de código abierto optimizado para cálculo. Destacando la importancia del acceso abierto a modelos avanzados, Cerebras lanzó Cerebras-GPT bajo la licencia Apache 2.0, permitiendo su utilización libre de regalías para aplicaciones tanto de investigación como comerciales.

Código Cerrado

La inteligencia artificial de código cerrado, por otro lado, involucra tecnologías propietarias que son desarrolladas y controladas por empresas u organizaciones específicas. El código fuente no es accesible públicamente, limitando la capacidad de modificarlo o distribuirlo. La IA de código cerrado ofrece ventajas como la protección de propiedad intelectual y soporte especializado. Sin embargo, carece de la transparencia y el desarrollo impulsado por la comunidad que se encuentra en la IA de código abierto. Ejemplos destacados de plataformas de IA de código cerrado incluyen Open AI GPT, IBM Watson y Microsoft Azure AI.

IA de Código Abierto vs IA de Código Cerrado

Al considerar el código abierto frente al código cerrado, entran en juego varios factores. En términos de rendimiento y funcionalidad, ambos modelos pueden ofrecer resultados impresionantes. Sin embargo, la IA de código abierto a menudo se beneficia del conocimiento colectivo de una comunidad más amplia, resultando en una innovación más rápida y un mayor rango de características.

La accesibilidad y el costo también son consideraciones importantes. El código abierto generalmente es gratuito para usar, haciéndolo más accesible para individuos y pequeñas organizaciones. Las plataformas de IA de código cerrado pueden requerir tarifas de licencia o suscripciones, haciéndolas más adecuadas para empresas más grandes con requisitos y presupuestos específicos.

Las implicaciones de privacidad y seguridad difieren entre los dos modelos también. La IA de código abierto fomenta la transparencia, permitiendo a los usuarios inspeccionar el código e identificar posibles vulnerabilidades. La IA de código cerrado, aunque proporciona medidas de seguridad robustas, puede generar preocupaciones sobre la privacidad de los datos y el manejo de información sensible.

El Espectro entre IA de Código Abierto y IA de Código Cerrado

Es importante reconocer que los modelos de código abierto y cerrado representan dos extremos en un espectro, con diferentes grados de apertura y control propietario en el medio. Algunas organizaciones adoptan un enfoque híbrido, utilizando una combinación de tecnologías de código abierto y cerrado para satisfacer sus necesidades específicas. Además, ciertos proyectos de código abierto pueden incorporar elementos de código cerrado con fines de comercialización.

Los modelos de licencia desempeñan un papel significativo en la determinación del nivel de apertura. Algunas licencias de código abierto, como la Licencia Pública General de GNU (GPL), requieren que las obras derivadas se publiquen bajo la misma licencia, asegurando la continuidad de la apertura. Otras licencias, como Apache License, permiten más flexibilidad en el uso y distribución del código.

¿Qué puede funcionar mejor para mis necesidades?

Actualmente, los modelos de código abierto y cerrado muestran niveles de rendimiento comparables ya que dependen de conjuntos de datos similares, abarcando la vasta extensión de la web abierta. Sin embargo, surge una pregunta crucial: ¿Pueden los modelos de código abierto, basándose únicamente en datos disponibles públicamente, mantener su competitividad frente a modelos de código cerrado equipados con conjuntos de datos propietarios? La respuesta radica en el caso de uso específico.

En dominios especializados como diagnósticos médicos, desarrollo farmacéutico, investigación científica avanzada y detección de fraudes, donde se requieren habilidades altamente especializadas, es probable que prevalezcan los modelos de código cerrado. Estas áreas implican costos sustanciales para adquirir datos de entrenamiento, lo que las hace menos propensas a ser incluidas en modelos de código abierto.

Por el contrario, los modelos de código abierto pueden competir suficientemente en áreas donde la experiencia no es el requisito principal. Tareas como el soporte al cliente, la conversación normal, la adaptación de texto y voz, el resumen de texto, la creación de fotos de archivo y la generación de correos electrónicos están bien adaptadas para modelos de código abierto. Los enfoques de aprendizaje por refuerzo con retroalimentación humana (RLHF) pueden mejorar estos dominios. En particular, incorporar datos adicionales en modelos de código abierto es más fácil en comparación con los datos propietarios, ya que las unidades individuales de datos tienen un valor menor. En ámbitos menos especializados, los modelos de código abierto están preparados para sobresalir, manteniendo un nivel satisfactorio de rendimiento sin quedar rezagados.

Consideraciones éticas y protección de la IA

En el cambiante panorama de la IA, el despliegue de sistemas de IA carece de normas estandarizadas, lo que lleva a debates sobre prácticas responsables. Mientras que los modelos de código abierto y cerrado tienen sus méritos, las consideraciones éticas son primordiales. La investigación de seguridad, las salvaguardias y las licencias responsables son necesarias para todos los sistemas, independientemente de su apertura. Las disposiciones técnicas por sí solas no son suficientes, y los marcos de políticas, la moderación de contenido y el intercambio de conocimiento entre laboratorios juegan un papel crucial para garantizar prácticas éticas en la IA. El marco de gradiente ofrece un enfoque matizado para analizar el acceso y tomar decisiones informadas sobre el lanzamiento. En última instancia, es esencial que los laboratorios evalúen los sistemas antes del despliegue, gestionen los riesgos después del lanzamiento y prioricen las consideraciones éticas a lo largo del proceso de desarrollo de la IA.

Conclusión

A medida que la IA sigue evolucionando, es crucial considerar las fortalezas y limitaciones de cada modelo. Las organizaciones deben evaluar sus requisitos, presupuesto, preocupaciones de privacidad y el nivel deseado de participación comunitaria. Además, el espectro entre la IA de código abierto y cerrado ofrece oportunidades para la innovación, modelos híbridos y adaptaciones de licencias.

En última instancia, el futuro del desarrollo de la IA radica en encontrar un equilibrio entre la apertura y el control propietario, asegurando que la tecnología beneficie a la humanidad en su conjunto. Al adoptar las fortalezas de la IA de código abierto y cerrado, podemos aprovechar todo el potencial de la IA para resolver problemas complejos y fomentar la innovación en la era digital.